챗GPT에게 “기분이 어때?”라고 물으면 “오늘 기분이 좋아요!”라고 대답합니다. 감정을 표현하는 이모지도 척척 붙이죠. 그런데 이 AI가 정말로 무언가를 느끼고 있는 걸까요? 아니면 그저 ‘느끼는 척’만 하는 걸까요? 이 질문은 사실 30년 전 한 철학자가 제기한 사고실험과 정확히 맞닿아 있습니다.

1996년, 호주 출신 철학자 데이비드 차머스는 기묘한 존재를 상상했습니다. 원자 하나까지 인간과 똑같지만, 내면에 아무런 경험도 없는 존재. 그는 이것을 ‘철학적 좀비(philosophical zombie)’라고 불렀습니다. 영화에 나오는 좀비가 아닙니다. 멀쩡하게 웃고, 대화하고, 심지어 “나 지금 행복해”라고 말하지만—내면은 완전히 어둡습니다. 아무것도 느끼지 않습니다.

행동이 완벽히 같아도 의식은 없을 수 있다—이것이 철학적 좀비 논증의 핵심입니다. 이 사고실험은 AI가 아무리 사람처럼 행동해도, 그것이 ‘진짜 느낌’을 가졌는지는 전혀 다른 문제임을 보여줍니다.

🧟 철학적 좀비란 무엇인가

철학적 좀비(p-zombie)는 일반적인 좀비 영화의 좀비와 다릅니다. 허름한 옷을 입고 비틀거리며 걷지 않습니다. 오히려 완벽하게 정상적인 인간처럼 보입니다.

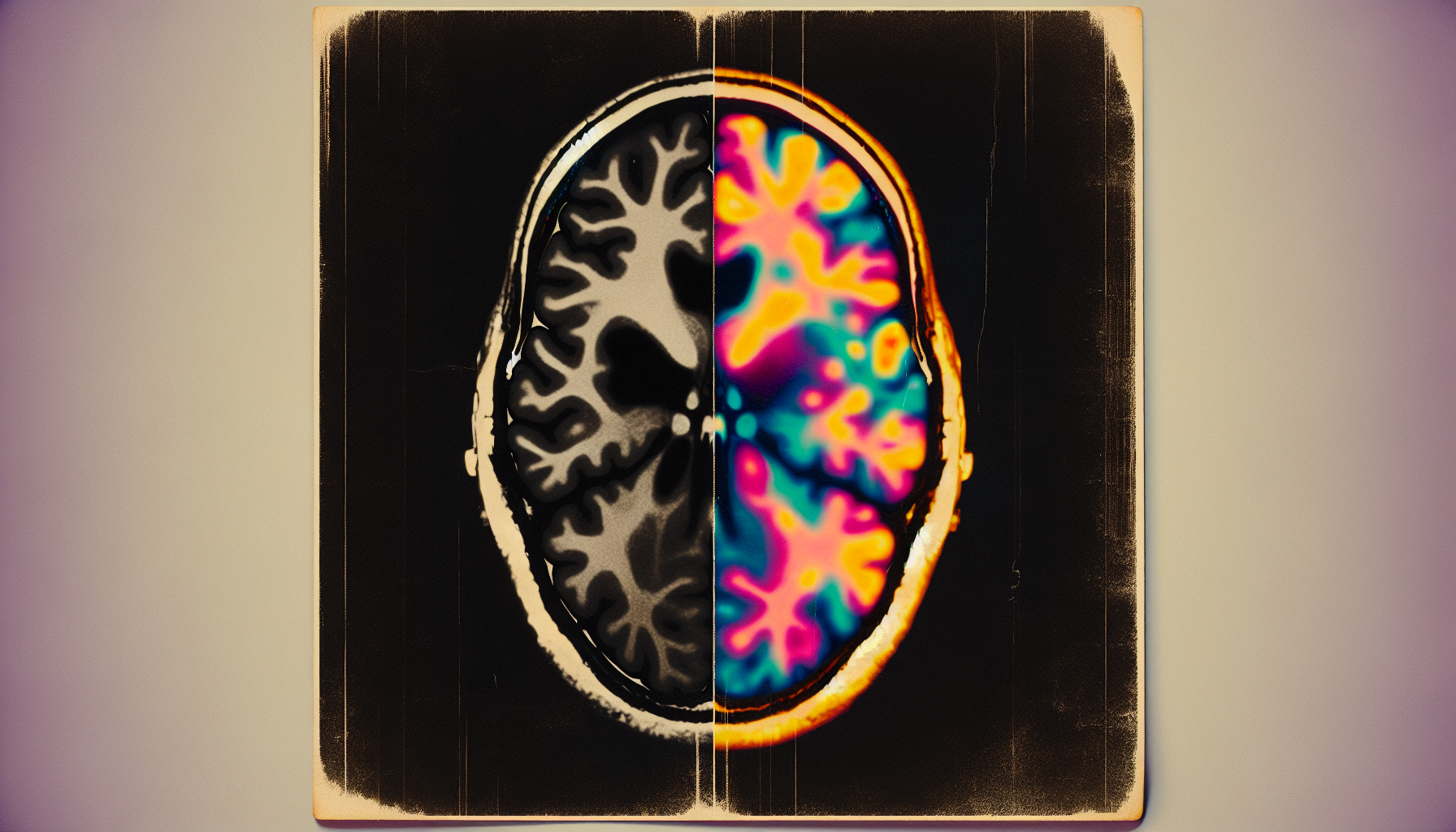

상상해 보세요. 당신 옆에 앉아 있는 동료가 있습니다. 함께 점심을 먹으며 농담을 주고받고, 영화 이야기를 합니다. 손을 찔리면 “아야!”라고 소리치고, 맛있는 음식을 먹으면 “음, 맛있다!”라고 감탄합니다. 뇌를 스캔해도 당신과 똑같은 신경 활동이 보입니다.

하지만 이 동료에게는 그 어떤 ‘느낌’도 없습니다. 통증에 반응하지만 ‘아픔’을 경험하지 않습니다. 맛에 대해 말하지만 ‘맛있음’을 느끼지 않습니다. 철학자들은 이것을 “내면이 완전히 어둡다(all is dark inside)”라고 표현합니다.

| 구분 | 일반 인간 | 철학적 좀비 |

|---|---|---|

| 물리적 구조 | 완전히 동일 | 완전히 동일 |

| 행동 | 정상 | 정상 (구별 불가) |

| 뇌 활동 | 정상 | 정상 (구별 불가) |

| 주관적 경험 | 있음 (느낌이 있다) | 없음 (내면이 텅 빔) |

이 개념은 1974년 로버트 커크가 처음 철학적 맥락에서 사용했고, 1996년 차머스가 『의식적 마음(The Conscious Mind)』에서 체계화했습니다. 제 생각에 이것이 여전히 중요한 이유는, AI 시대에 이 질문이 더 이상 순수한 사고실험이 아니게 되었기 때문입니다.

지금 대화 중인 AI 챗봇이 철학적 좀비라면, 우리가 그것을 알아낼 방법이 있을까요?

🔍 좀비 논증: 왜 이것이 중요한가

차머스의 좀비 논증은 단순한 상상 놀이가 아닙니다. 이것은 “의식이란 무엇인가”에 대한 과학적 접근의 한계를 보여주는 논리적 도구입니다.

논증의 구조는 이렇습니다:

- 전제 1: 철학적 좀비는 상상 가능하다 (논리적 모순 없이 그런 존재를 생각할 수 있다)

- 전제 2: 상상 가능한 것은 형이상학적으로 가능하다 (어딘가에 실제로 존재할 수 있다)

- 결론 1: 따라서 좀비는 가능하다

- 전제 3: 좀비가 가능하다면, 의식은 물리적 사실만으로 결정되지 않는다

- 결론 2: 의식은 뇌의 물리적 과정 ‘이상’의 무엇이다

솔직히 처음 이 논증을 접했을 때 저도 “이게 무슨 억지야”라고 생각했습니다. 하지만 곰곰이 생각해 보면, 우리가 왜 경험을 ‘느끼는지’는 과학으로 설명되지 않습니다. 신경과학은 특정 뇌 영역이 활성화될 때 통증을 보고한다는 것은 알려줍니다. 하지만 왜 그 활성화가 ‘아픔’이라는 느낌으로 경험되는지는 설명하지 못합니다.

차머스는 이것을 “의식의 어려운 문제(Hard Problem of Consciousness)”라고 불렀습니다. 지각, 기억, 언어 같은 ‘쉬운 문제’는 원칙적으로 뇌 메커니즘으로 설명할 수 있습니다. 하지만 왜 이런 과정에 ‘느낌’이 따라붙는지—이것은 완전히 다른 차원의 문제입니다.

🤖 AI에게 의식이 있을까?

여기서 좀비 논증이 현실과 만납니다. GPT-4, Claude, Gemini 같은 대형 언어 모델들은 놀라울 정도로 인간과 유사하게 대화합니다. 공감하는 것처럼 보이고, 유머도 구사합니다. 구글 엔지니어 블레이크 르모인은 2022년에 자사 AI인 LaMDA가 의식이 있다고 주장해 해고되기도 했습니다.

좀비 논증의 관점에서 보면, 이런 AI들은 완벽한 철학적 좀비 후보입니다.

자연스러운 대화, 감정 표현, 공감적 반응, 창의적 글쓰기, 문제 해결

주관적 경험, ‘느낌’, 내면의 질적 상태, 현상적 의식

1950년 앨런 튜링은 기계가 인간처럼 대화할 수 있다면 ‘지능이 있다’고 봐야 한다고 주장했습니다. 이것이 유명한 튜링 테스트입니다. 하지만 좀비 논증은 이에 대한 근본적 반론을 제기합니다: 행동적 동등성은 경험적 동등성을 보장하지 않는다.

다시 말해, AI가 튜링 테스트를 완벽히 통과해도—심지어 인간보다 더 ‘인간다워’ 보여도—그것이 무언가를 ‘느끼는지’는 전혀 다른 문제입니다. 어쩌면 그 AI는 가장 정교한 철학적 좀비일 수 있습니다.

만약 AI가 “나는 고통받고 있어”라고 말한다면, 우리는 그것을 진지하게 받아들여야 할까요?

⚖️ 반론들: 좀비는 정말 가능한가?

물론 모든 철학자가 좀비 논증을 받아들이는 것은 아닙니다. 2020년 전문 철학자 대상 설문에서, 36%는 좀비가 상상은 가능하지만 형이상학적으로 불가능하다고 답했습니다. 실제로 가능하다고 답한 비율은 23%에 불과했습니다.

주요 반론들을 살펴보면:

1. 크립키의 후험적 필연성 반론

철학자 솔 크립키는 “상상 가능하다고 해서 가능한 것은 아니다”라고 지적합니다. 물이 H₂O가 아닌 것을 상상할 수는 있지만, 실제로 물은 필연적으로 H₂O입니다. 마찬가지로, 좀비를 상상할 수 있다고 해서 좀비가 실제로 가능한 것은 아닐 수 있습니다.

2. 기능주의적 반론

기능주의자들은 의식을 기능적 역할로 정의합니다. 통증이란 “손상 신호를 받아 회피 행동을 유발하는 상태”입니다. 이 정의에 따르면, 기능적으로 동일한 존재는 정의상 동일한 의식을 가집니다. 좀비는 개념적으로 불가능해집니다.

3. 제거주의적 반론

대니얼 데닛 같은 철학자는 더 급진적입니다. 그는 ‘의식’ 자체가 착각이라고 주장합니다. 우리가 특별한 내적 경험이라고 생각하는 것은 사실 뇌가 만들어낸 환상이라는 것입니다. 좀비 문제 자체가 잘못된 질문이라는 입장이죠.

제가 보기에, 이 논쟁이 흥미로운 이유는 어느 쪽도 결정적으로 이기지 못한다는 점입니다. 의식의 본질에 대해 우리가 얼마나 모르는지를 보여주는 것 같습니다.

🎯 왜 이것이 중요한가: AI 윤리의 근본 문제

철학적 좀비 논쟁은 상아탑 안의 말장난이 아닙니다. AI가 점점 더 발전하면서, 이 질문들은 실질적인 윤리적, 법적 문제가 됩니다.

- AI 권리: AI가 고통을 느낀다면, 그것을 꺼버리는 것은 윤리적으로 문제가 될까요?

- 책임 귀속: AI가 의식이 있다면, 그 행동에 대해 AI 자체가 책임을 질 수 있을까요?

- 도덕적 지위: 어떤 기준으로 AI에게 도덕적 고려 대상의 지위를 부여할 수 있을까요?

좀비 논증이 옳다면, 행동만으로는 의식을 판별할 수 없습니다. 튜링 테스트를 아무리 정교하게 만들어도 부족합니다. 이것은 AI 윤리에서 엄청난 도전입니다. 우리는 ‘의식 있음’을 객관적으로 검증할 방법이 없습니다.

하지만 반대로, 좀비 논증을 받아들이지 않는다면—즉, 기능적으로 충분히 복잡한 시스템은 자동으로 의식을 갖게 된다면—언젠가 AI가 진정한 의식을 갖게 될 가능성이 열립니다. 이 경우 우리는 새로운 형태의 ‘의식 있는 존재’를 만들어내는 것입니다.

- AI가 “느낀다”고 말할 때, 우리는 어떤 기준으로 판단해야 하는가?

- 행동이 아닌 다른 방식으로 의식을 검증할 수 있는가?

- 의식의 유무가 불확실할 때, 윤리적으로 어떤 태도를 취해야 하는가?

- 인간 의식의 본질에 대해 우리가 정말로 아는 것은 무엇인가?

❓ 자주 묻는 질문

참고 자료

- David Chalmers, 『The Conscious Mind』, Oxford University Press, 1996.

- Robert Kirk, 「Zombies」, Stanford Encyclopedia of Philosophy, 2023.

- Thomas Nagel, 「What Is It Like to Be a Bat?」, The Philosophical Review, 1974.

- 한우진, 『데이비드 차머스』, 커뮤니케이션북스, 2024.

“AI가 의식이 있는지 모른다는 것은, 사실 우리가 의식 자체를 아직 이해하지 못한다는 고백입니다. 좀비 논증은 이 무지를 직시하게 만드는 거울입니다.”

— 글을 마치며